ChatGPT ist ein mächtiges neues Tool, das Unternehmen enormen Mehrwert bieten, aber auch großen ecuritychaden anrichten kann. Rodman Ramezanian, Global Cloud Threat Lead bei Skyhigh Security, erklärt, wie Cybersecurity-Verantwortliche schon heute von ChatGPT profieren können – und warum sie dennoch Vorsicht walten lassen sollten.

Der generative KI-Chatbot ChatGPT hat sich in kürzester Zeit als einer der spannendsten, beliebtesten, aber auch am hitzigsten diskutierten Cloud-Services etabliert. Gerade einmal zwei Monate brauchte der Chatbot, um die magische Grenze von 100 Millionen aktiven Usern pro Monat zu erreichen. Und auch in der Businesskommunikation ist ChatGPT längst angekommen: Die weltweiten Telemetriedaten von Skyhigh Security belegen, dass inzwischen eine Million User ChatGPT über die IT-Infrastruktur ihres Unternehmens nutzt. So kommt der KI-basierte Bot privat und geschäftlich in den unterschiedlichsten Bereichen zum Einsatz: von der Erledigung von Hausaufgaben bis hin zum Verfassen technischer Whitepapers und kritischer Geschäftsberichte. Die Möglichkeiten scheinen endlos.

Die Risiken neuer Technologien

So aufregend und nützlich die neue Technologie mit ihren unendlichen Möglichkeiten auch ist: Die Security-Verantwortlichen der Unternehmen sind gut beraten, angesichts der rasant steigenden Zugriffszahlen sehr genau hinzusehen. Denn wie jedes neue Tool birgt auch ChatGPT eine Reihe von Gefahren – und kann von feindlichen Akteuren für gezielte Angriffe zweckentfremdet werden. Ein praxisnahes Beispiel für einen solchen möglichen Missbrauch des Bots ist das Verfassen passgenauer Phishing-Nachrichten zu unterschiedlichsten Themen: Zwar weigert sich ChatGPT, wenn man den Bot rundheraus bittet, eine Phishing-Mail zu verfassen – dafür sorgt die hinterlegte Filterfunktion, die zumindest oberflächlich den ethischen Rahmen bei der Nutzung überprüfen soll. Geht der Angreifer aber etwas weniger offensiv vor, und bittet etwa darum, eine Mail-Vorlage für ein Arbeitsevent zu verfassen, ist ChatGPT bereitwillig zu Diensten. Diese Vorlage liefert dann ohne großen Aufwand eine solide Basis für Phishing-Mails.

Nun lässt sich durchaus argumentieren, dass Hacker ohnehin längst in der Lage sind, Angriffe zu automatisieren und verschiedene Formen von KI/ML für ihre Zwecke zu missbrauchen. Spinnt man diesen Gedanken allerdings weiter, kommt man schnell zur Erkenntnis, dass ChatGPT den feindlichen Akteuren ihre Arbeit durchaus nachhaltig erleichtern kann und individualisierte Angriffe im großen Stil ermöglicht.

Erschwerend kommt hinzu, dass chat.openai.com jederzeit für jedermann zugänglich ist. Also geht zukünftig nicht nur von versierten Profi-Hackern – die sich ganz genau mit komplexen Exploits und System-Schwachstellen auskennen – eine Gefahr für IT-Architekturen aus. Auch Anfänger und Jugendliche ohne nennenswertes IT-Know-how können – ganz wie die berüchtigten Script-Kiddies früherer Jahre – gravierende Schäden anrichten. Rein theoretisch ist es selbst für einen Schüler, der ChatGPT eigentlich nur für Ausbildungszwecke nutzt, möglich, verheerende Buffer-Overflow-Angriffe für gängige Webbrowser zu initiieren.

Skyhigh Security unterstützt Unternehmen bei der Risikoeinschätzung

Das Beispiel belegt, wie einfach und damit auch wahrscheinlich ein Missbrauch des Chatbots durch Hacker ist. Für Security-Verantwortliche ist es daher unerlässlich, wachsam zu bleiben und die neuesten Entwicklungen im Bereich KI im Auge zu behalten. Denn wie bei allen Technologien muss man ihre Risiken erst genau kennen, bevor man sich davor schützen kann.

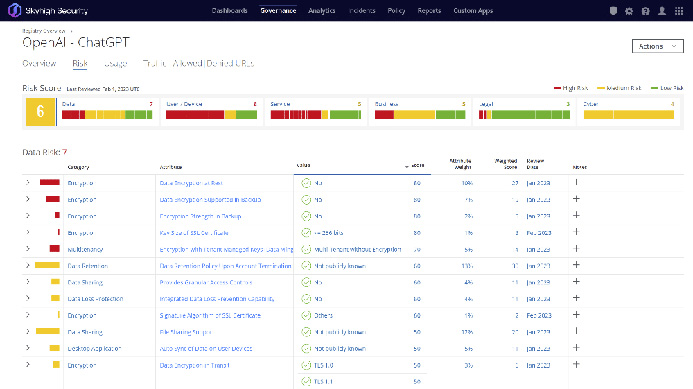

Einen ersten Einblick in die unübersichtliche und immer mehr ausufernde Welt der KI-basierten Cloud-Services liefert Unternehmen die Skyhigh Security Cloud Registry: In diesem umfassenden Verzeichnis analysieren unsere Experten derzeit über 40.000 SaaS-, PaaS- und IaaS-Dienste, von denen allein 500 in den Bereich der AI-basierten Cloud-Services entfallen. ChatGPT ist hier nur ein Dienst von vielen.

Im Rahmen dieses Registers werden die Cloud-Dienste zudem mit einem transparenten Security-Rating klassifiziert, das es Unternehmen leicht macht, einzuschätzen, ob sie einen bestimmten Service bedenkenlos nutzen können. Hierfür ermitteln wir den Durchschnittswert aus 75 gemeinsam mit der Cloud Security Alliance (CSA) entwickelten Risikoattributen. Das Bewertungsschema umfasst dabei unter anderem die Kategorien Daten, Benutzer/Geräte, Dienste, Unternehmen, Rechtslage und Cyber, von denen jede mit einem Wert zwischen 1 und 9 bewertet wird. Diese Einschätzung gibt Unternehmen anschließend einen guten Ausgangspunkt für die Definition verbindlicher Cloud-Governance-Richtlinien für ihre Mitarbeitenden.

Dabei sollten Security-Verantwortliche für jeden Dienst folgende Fragen beantworten:

- Hat ein Mitarbeiter die Seite aufgerufen/genutzt? Wenn ja, wie oft ist das vorgekommen und wer genau hatte Zugriff?

- Wurde über die Web- und Cloud-Infrastruktur des betreffenden Unternehmens auf den Dienst zugegriffen?

- Und wenn eine der beiden vorherigen Fragen mit „Ja“ beantworten wurde, wie viele Daten wurden dann zwischen dem Unternehmen und diesem Dienst ausgetauscht?

Aufsetzend auf diese Auswertung können die Security-Teams dann konkrete Maßnahmen zum Schutz der Geräte, Web- und Cloud-Umgebungen einleiten – und beispielsweise entscheiden, ob der Zugang zu diesem Dienst eingeschränkt oder komplett blockiert werden muss. Ferner lassen sich viele weitere Sicherheitsmaßnahmen initiieren: etwa, indem Nutzer darauf hingewiesen werden, dass ein Dienst, auf den sie gerade zugreifen wollen, als bedenklich eingestuft wurde, oder indem die Datenmenge, die sie hochladen dürfen, begrenzt wird.

Zusammenfassung

Dass Künstliche Intelligenz und Machine Learning die Cybersecurity bereichern, steht außer Frage. Die Technologien heben etwa die Analyse von Datenverkehr in Echtzeit auf einen ganz neuen Level, weil sie Auffälligkeiten wesentlich schneller erkennen – und oft stoppen, bevor Schaden entsteht. Auch ChatGPT bietet Cybersecurity-Teams eine Reihe spannender Vorzüge: Man kann den leistungsfähigen Chatbot zum Beispiel dazu nutzen, riesige Datenmengen zu sammeln, um Systemstresstests zu erleichtern oder Fuzzing-Tests in der Software-Entwicklung durchzuführen. Theoretisch ist es sogar denkbar, feindliche Angriffe auf ein System zu Übungszwecken zu inszenieren.

Ungeachtet dieser Vorzüge – und obwohl ChatGPT noch in den Kinderschuhen steckt – stehen mit Blick auf die Nutzung aber bereits etliche moralische Fragen im Raum: Es scheint ja nur eine Frage der Zeit zu sein, bis sich Hacker den Bot zu eigen machen und ihn für unlautere Zwecke missbrauchen. Daher gilt es, die junge Technologie sorgsam im Auge zu behalten, um sicherzustellen, dass das Gleichgewicht zwischen Nutzen und Risiken nicht in die falsche Richtung kippt. (ah)